Всем хороши современные твердотельные накопители — только маловаты и дороговаты. Хотя на деле это даже не два недостатка, а всего один. Просто при нынешней цене каждого гигабайта флэш-памяти наибольшим спросом на «персональном» рынке пользуются модели, где этих самых гигабайтов не слишком много. В бюджетном сегменте — так и вовсе минимальное количество. Поэтому в недорогих компьютерах нередко можно увидеть SSD на 256 ГБ, а то и на 128 ГБ, да и в рознице подобные накопители все еще очень популярны. Хотя ими ассортимент магазинов не ограничивается — можно найти и что-нибудь на 1-2 ТБ, а то и на несколько терабайт. За последним обычно приходится обращаться к моделям, официально как потребительские не позиционируемым, но принципиальных проблем это не создает.

Немного сложнее в случаях, когда требуется не только высокая емкость, но и скорость. Причем, желательно, стабильно-высокая скорость. И речь не о пресловутом «рандоме» — на деле возможностей флэш-памяти достаточно для того, чтобы даже бюджетный SSD обеспечивал все сегодняшние требования к «персональному» накопителю с запасом. «Затык» случается совсем в другом месте — с, казалось бы, простыми линейными операциями. Впрочем, простыми они казались во времена винчестеров, когда выполнялись медленно, но на фоне того, как с любыми другими нагрузками «механика» справлялась ужасно медленно, проблем заметно не было. Твердотельные накопители с любыми операциями управляются быстро или очень быстро, но если чтение данных (в любом виде) проблем не вызывает никогда, то с записью все сложнее. Особенно в свете тенденции увеличения плотности чипов, что приводит к снижению их «собственной» скорости записи. Маскировать это приходится изощренными схемами буферизации, которые справляются в относительно простых случаях, но нередко пасуют при увеличении нагрузки. Современный SSD может писать данные со скоростью несколько гигабайт в секунду — но недолго. На такой скорости можно записать в лучшем случае треть свободного места (которого на рабочем устройстве может быть немного), а дальше она снизится до нескольких сотен (а то и десятков) мегабайт в секунду.

Спасает только то, что методы борьбы с такими проблемами давно известны: объединение дисков в массивы с чередованием позволяет существенно увеличить скорость выполнения операций с последовательным доступом. Вот «рандом» в массиве SSD подстегнуть практически невозможно (поскольку внутренний параллелизм справляется не хуже внешнего — а он в этих устройствах, в отличие от жестких дисков, есть всегда), но это и не требуется. Требуется же увеличить скорость последовательного чтения — и записи тоже, причем сделав последнюю более стабильной. Правда, собирать массив из SATA SSD уже неинтересно: суммарная скорость все равно будет ограничена пропускной способностью самого интерфейса, просто умножится на количество используемых устройств. В итоге RAID0 из шести SATA-устройств, например, только-только догонит (как минимум, при чтении) одиночный NVMe-накопитель. Стало быть, массив следует строить из NVMe SSD. Это логично, эффективно, перспективно — однако линий PCIe в типичной настольной системе маловато, так что без ухищрений и без ущерба для других устройств редко получается собрать массив из более чем трех-четырех накопителей. В HEDT-системах самих линий PCIe порядком, но обычно они распределены по «длинным» слотам, зачастую не поддерживающим расщепление, так что идея воткнуть в PCIe x16 пассивный адаптер под четыре SSD может и не прокатить. И даже если получится, то программные средства для создания таких массивов могут оказаться платными — либо сильно ограниченными.

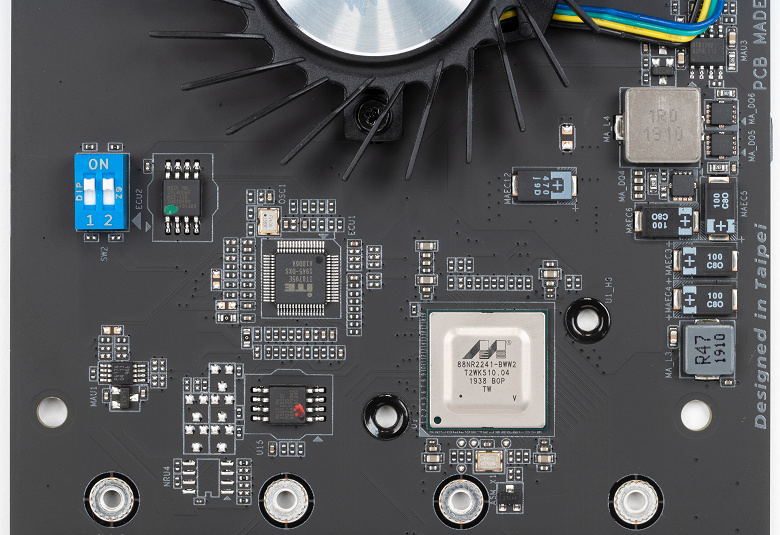

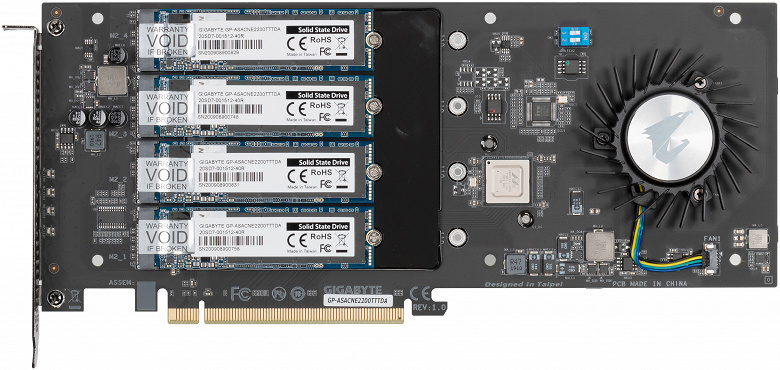

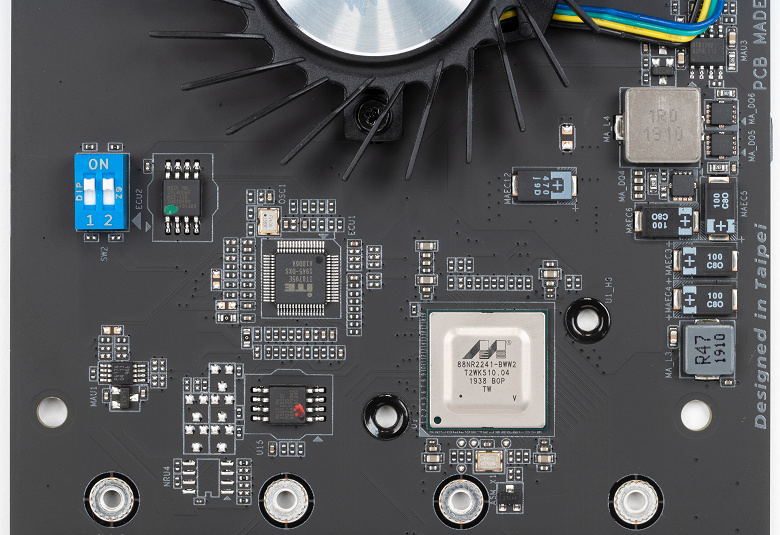

Однако и такие проблемы производители тоже научились решать давно. Столько же лет, сколько используются и дисковые массивы. Просто некогда RAID-контроллер устанавливался в разъем системной шины, а к нему подключались накопители с интерфейсом SCSI или PATA (для экономии) — сейчас же с обеих сторон PCIe. Тоже ничего особенного: чипы-коммутаторы встречались со времен появления PCI Express. Остается научить такой «разветвитель» прикидываться NVMe-накопителем и поддерживать подключение (с возможностью объединения) четверки таких накопителей к «исходящим» линиям, и получим мы... например, контроллер Marvell 88NR2241. Он является дальнейшим развитием линейки SATA/SAS-контроллеров компании, но представляет собой перенос «традиционной» функциональности на более высокий уровень. Естественно, популярен он в корпоративном секторе, для которого и разработан. В то же время, стоит Marvell 88NR2241 не слишком дорого, так что пригоден и для создания интересных продуктов «персонального» назначения. Таких, как наш сегодняшний герой.

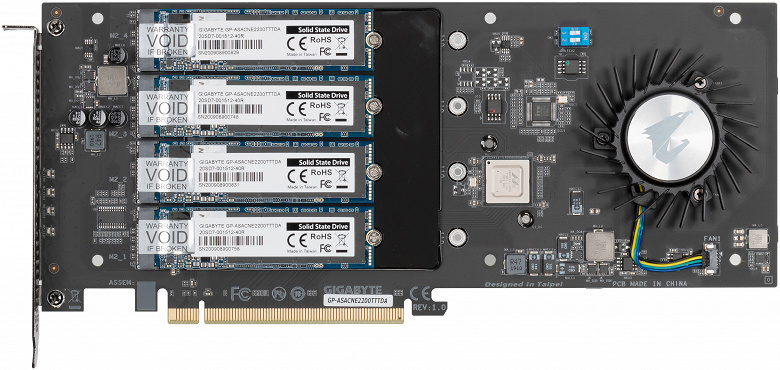

Gigabyte Aorus RAID AIC SSD 2 ТБ

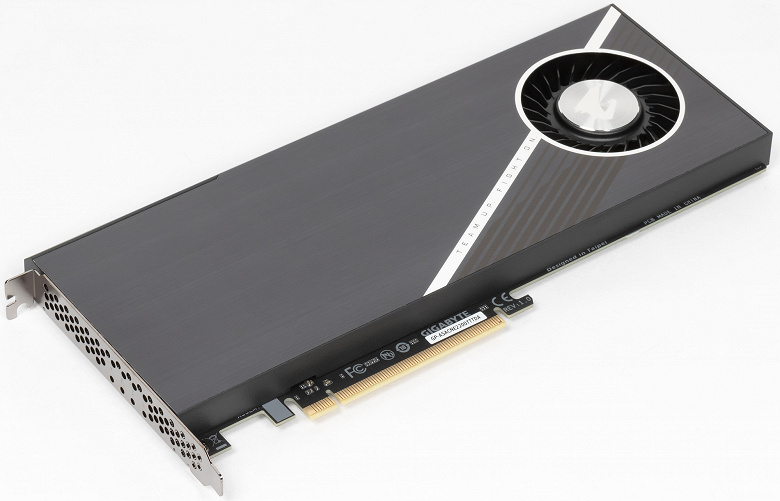

В ассортименте компании эта модель дополняет AIC-линейку SSD на базе контроллера Phison E12, куда ранее входили два накопителя — емкостью 512 ГБ и 1 ТБ, а больше среди устройств с интерфейсом PCIe 3.0 и не было. Вот для PCIe 4.0 компания выпускает SSD формата M.2 2280 с емкостью до 2 ТБ, и похожую внешне (но не внутренне!) AIC-плату на 8 ТБ, причем первые полностью совместимы и со старыми системами — так что вроде бы новинка не так уж нужна. Ту же емкость можно получить и в более компактном исполнении — и также можно устанавливать четыре SSD в один слот PCIe x16. Только вот «старшее» AIC-решение дополнительными контроллерами не снабжено, так что для его работы в обязательном порядке требуется расщепление линий в слоте — а таких моделей системных плат не слишком много. В остальных случаях будет «виден» только один SSD из четырех, а Aorus RAID дает доступ ко всем — на любой системе любого производителя, причем можно устанавливать устройства в слоты PCIe x4 или и вовсе х1 (скорость это ограничит, но физически работать будет). Возможность установить четыре накопителя в разъем для одного, в общем-то, востребована, но лучше всего использовать устройство в слоте с восемью линиями: это самый быстрый режим. По пропускной способности PCIe 3.0 x8 и PCIe 4.0 x4 равны, так что компания позиционирует карту Aorus RAID AIC как лучшее решение для модернизации старых систем, владельцы которых хотели бы оценить прелести PCIe 4.0, но не могут. На деле же все гораздо интереснее, чем кажется на первый взгляд

В первую очередь — благодаря наличию упомянутого выше контроллера Marvell 88NR2241, который позволяет гибко настраивать режимы работы «внутреннего» дискового пула, прозрачным для системы образом. Например, все SSD могут работать независимо — т. е. это как раз способ «воткнуть» четыре накопителя в разъем для одного. Ограничением скорости в таком режиме можно и пренебречь — в конце концов, в системах на базе процессоров Intel те же четыре линии PCIe 3.0 служат и для связи чипсета с процессором, т. е. такое узкое место существует и если устанавливать их в отдельные слоты PCIe/M.2, подключенные к чипсету. Однако на практике чтобы в него «упереться» приходится специально постараться — и создать не встречающиеся в реальной жизни условия. Аналогичное верно и для подобных массивов. Но лучше, конечно, «найти» свободный длинный слот — благо 88NR2241 для связи с системой может использовать до восьми линий PCIe 3.0! Правда в настольных платформах LGA115x/LGA1200/AM4 сделать это можно только «обидев» видеокарту, что не всегда желательно. А вот в LGA2011-3/LGA2066 или TR4 свободный длинный слот можно найти и не в ущерб другим компонентам, так что для них такие сборки более интересны.

«Выжать» же максимум из интерфейса можно, используя накопители не поодиночке, а объединив их в массив. По умолчанию карта и сконфигурирована как RAID0 из четырех устройств — суммарной емкостью 2 ТБ. На самом деле контроллер поддерживает и другие варианты — например, массив RAID10: с емкостью в 1 ТБ, высокой скоростью, но защитой от выхода их строя любого из четырех SSD. А можно сделать и RAID1 из пары SSD — и RAID0 из другой пары: получим быстрый дисковый пул на 1 ТБ и отказоустойчивый еще на 500 ГБ. Что, конечно, при нынешних ценах на SSD выглядит немного натянутым — но может кому-то оказаться и интересным. Либо еще один практический вариант — RAID0 из трех SSD (емкость 1,5 ТБ) плюс одиночный накопитель на 500 ГБ.

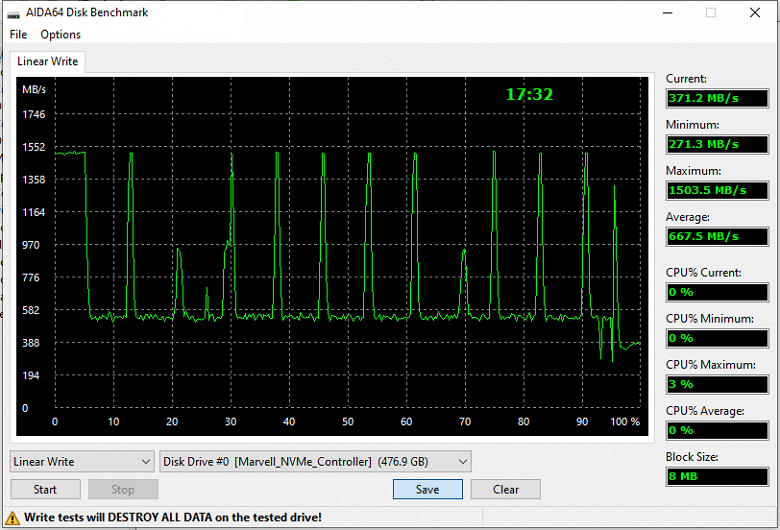

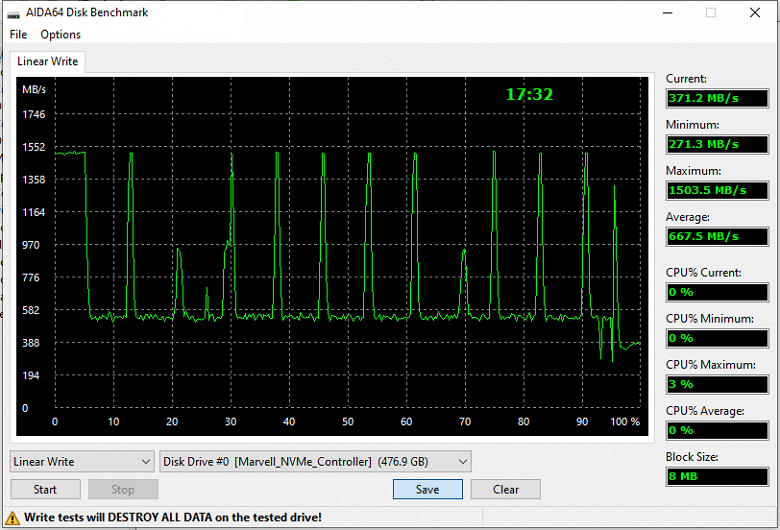

Хотя на деле можно оставить и все как есть — используя чередование для увеличения скорости. Во-первых, это всегда будет выполнено для операций чтения — как раз так можно «загрузить» работой PCIe 3.0 x8. Во-вторых, ситуация с записью еще более забавная. Ни для кого не секрет, что современные SSD активно используют SLC-буферизацию, а все скоростные показатели декларируются именно для SLC-кэша, имеющего ограниченные размеры: в любом случае не больше трети свободного места. Если необходимо записать большее количество информации, скорость записи радикально упадет. Например, недавно мы тестировали терабайтный Seagate FireCuda 520 с интерфейсом PCIe 4.0 и выяснили, что новый интерфейс имеет значение лишь при ограниченных объемах данных. А после исчерпания кэша скорость записи снижалась до 500-600 МБ/с. Т. е. новейший SSD в некоторых случаях можно считать и за ограничения SATA600 не вышел — что сильно расстраивает пользователей, вынужденных «ворочать» большими объемами данных.

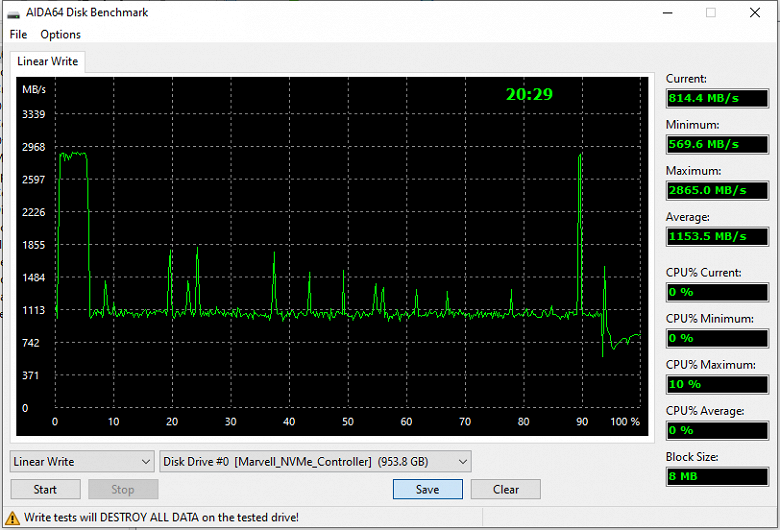

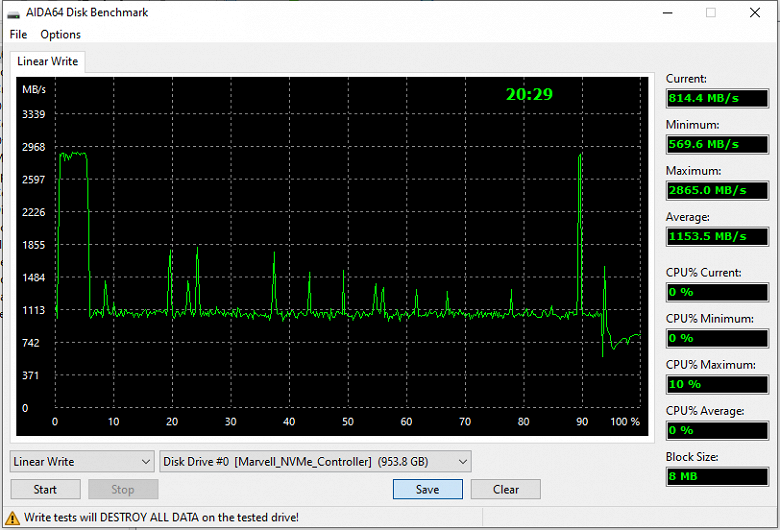

Чем нам могут помочь массивы? Начнем со случая одиночного накопителя — как базы. Хорошо заметно, что быстродействие «базового» элемента примерно соответствует другим SSD на базе контроллера Phison E12 с TLC-памятью Kioxia BiCS3 той же емкости — в SLC-кэш они умеют писать со скоростью более 1,5 ГБ/с, а вот в основной массив памяти — лишь примерно 550 МБ/с. Повторимся — это не особенность конкретной модели, а стандартное поведение SSD этого класса. Из 1-2 ТБ можно выжать и больше — но не принципиально больше. Пиковые скорости, разве что, будут выше — поскольку 88NR2241 каждому отдельному SSD отводит лишь две линии PCIe 3.0, но актуальны они в случае одиночного устройства лишь в небольшой области.

Но если добавить внешнего параллелизма — скорости при последовательной нагрузке закономерно складываются, так что получаем мы стабильно не ниже 1 ГБ/с, а в пиках — и 3 ГБ/с. Второе может обеспечить и одиночный терабайтник, первое — лишь редкие таковые модели.

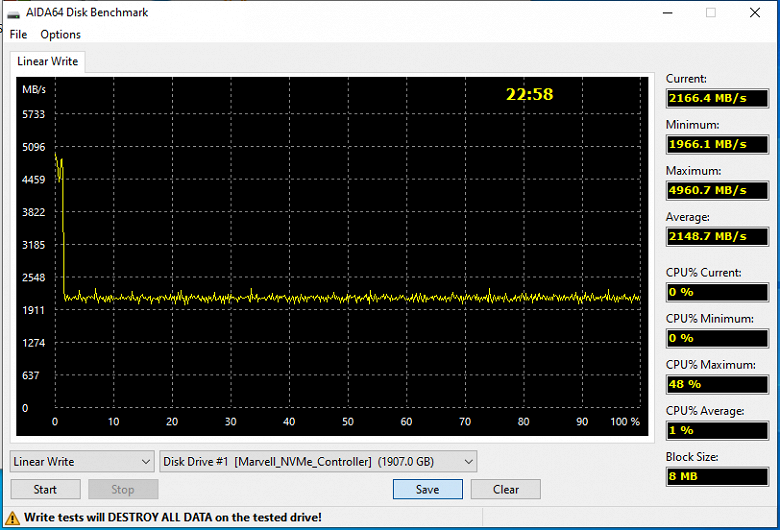

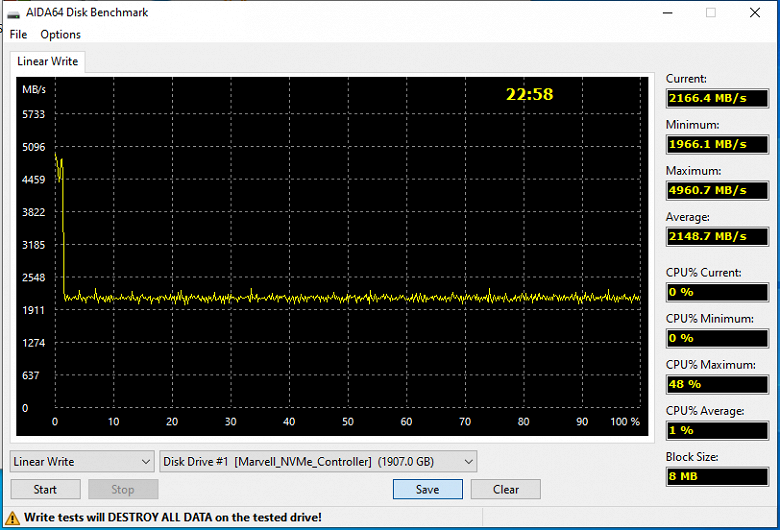

А четверка SSD (конфигурация по умолчанию) дает уже стабильно около 2 ГБ/с на основной части массива и 5 ГБ/с в «быстрой» области. Отметим, что первое-то можно получить в устройствах высокой емкости («небытовых» официально, хотя временами и относительно недорогих), а вот второе в обязательном порядке требует поработать с внешним интерфейсом.

Но есть один момент, который необходимо учитывать — массивы положительно сказываются на скорости выполнения последовательных операций, однако на «рандом» в случае SSD действуют не всегда — и не всегда в положительную сторону. В принципе, на практике в персональном компьютере это не мешает, поскольку даже бюджетные твердотельники не просто отлично справляются с типичными нагрузками такого плана, но и делают это с запасом — но помнить об этом стоит. Единственный вариант действительно ускорить практически значимые показатели на операциях со случайным доступом — отказаться от NAND-флэш и перейти на, например, Optane. Но это совсем иная история... а вот «ворочать» большими объемами информации в случае RAID-массивов становится удобнее, чем без них.

При этом такие решения, как Aorus RAID AIC SSD позволяют снять некоторые проблемы, мешающие активному использованию программных и «чипсетных» массивов. Первое-то давно встроено в операционные системы — только вот проблемы нередко возникают даже с загрузкой самой системы. Да и со свободными слотами они тоже нередки — не на всякую плату, например, можно установить сразу четыре SSD и объединить их в массив. Свои ограничения есть зачастую и у HEDT-систем, где с возможностью подключения попроще — но и только. Marvell 88NR2241 инкапсулирует всю логику внутри — для системы это просто обычный NVMe-накопитель или несколько таких (до четырех). Соответственно, работает это на любых платах, под управлением практически любых ОС и т. п. По большому счету смысл есть даже если найдется только свободный слот с четырьмя линиями PCIe — а восемь позволят и увеличить пиковую скорость.

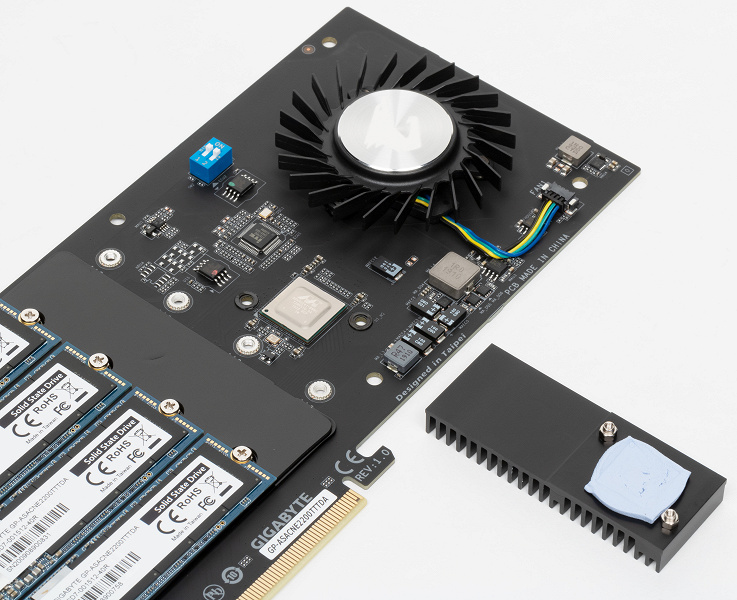

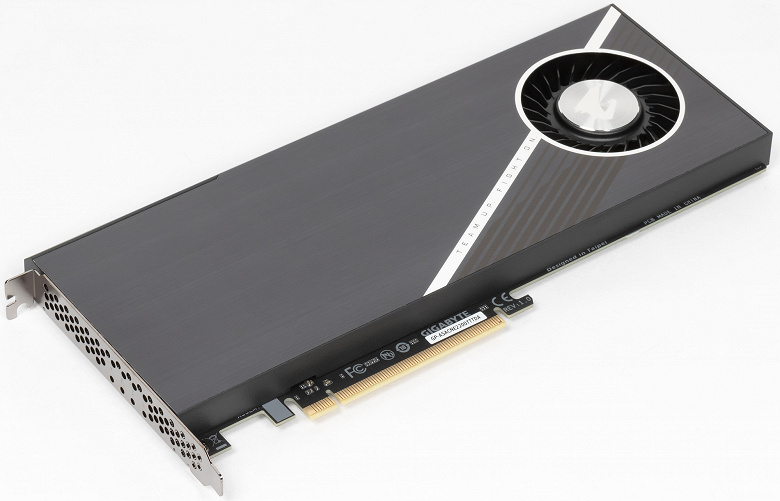

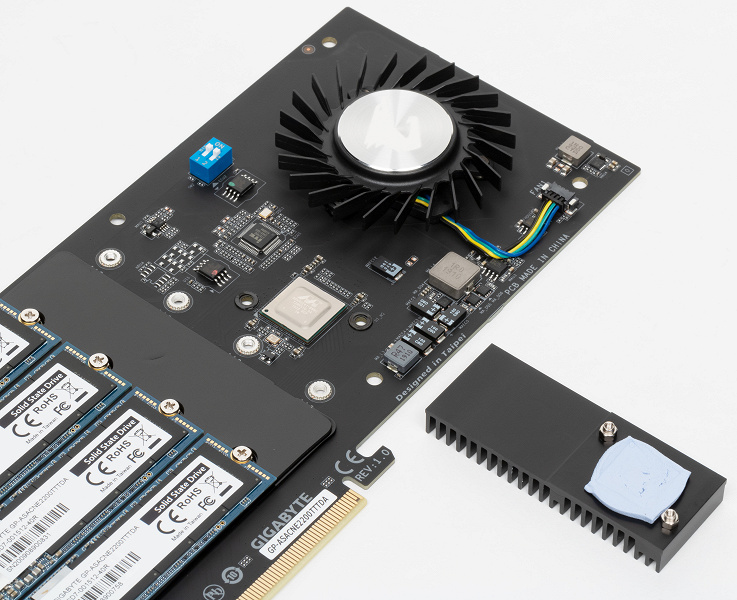

Кроме того, можно не заботиться о температурном режиме накопителей — что до сих пор иногда вызывает проблемы. В данном случае адаптер снабжен и большим радиатором для всех накопителей, и вентилятором для продува системы. Скорость вращения последнего выбрана таковой, чтобы не выделяться на общем фоне системы. На деле, даже, во время тестирования нам сначала казалось, что специально установлен минимальный уровень шума. Проверка показала, что это средний профиль - можно сделать еще тише. Или, наоборот, холоднее.

Правда с конфигурированием и настройками уже возможны некоторые ограничения.

Совместимость и управление

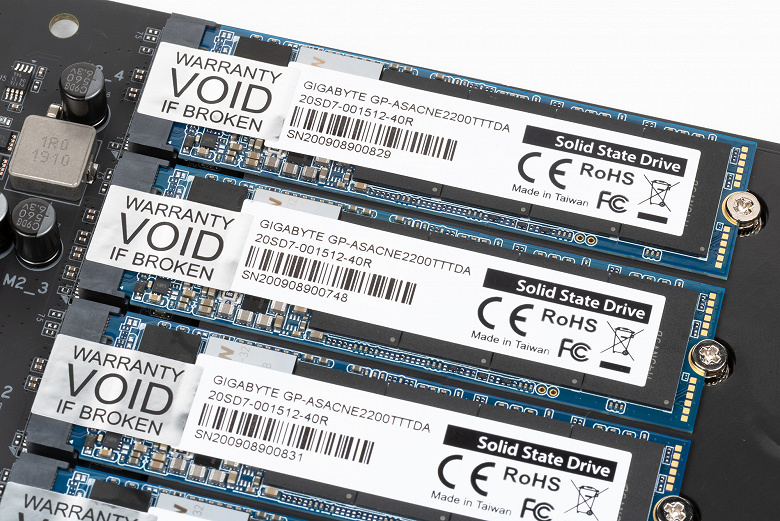

Конкретный адаптер сделан (если к этому абзацу кто-то уже забыл) Gigabyte. При этом ограничений на начинку компания не накладывает: внутри установлены SSD ее производства, причем их извлечение лишает гарантии, но после ее окончания (или если это не пугает) — можно и поменять на другие. Причем то, что контроллер, в общем-то, multi-LUN, позволяет апгрейдить устройство и «по частям» — по мере возникновения необходимости.

Что касается «наружного» интерфейса, то с ним на первый взгляд тоже все отлично — как уже сказано, устройство прекрасно работает в любых системных платах всех производителей, причем скоростной режим ограничен лишь сверху, но не снизу. В частности, мы устанавливали Aorus RAID в нашу стандартную тестовую систему на базе платы ASRock Z270 Killer SLI — отлично функционировала как в процессорных слотах, так и в чипсетных PCIe x1 (благо они там «пропиленные»); пусть и на ограниченной скорости. Однако при этом исчезают все возможности конфигурирования, т. е. даже массив не перестроишь.

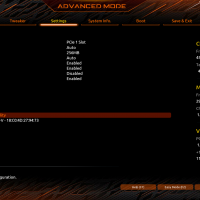

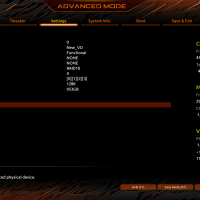

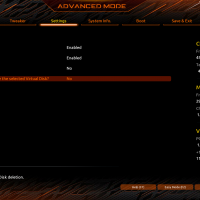

Полное управление обеспечивается исключительно при использовании плат Aorus/Gigabyte на базе чипсетов AMD X570 и TRX40, а также Intel X299, Z390 и Z490. К счастью, у нас под рукой как раз оказалась новенькая Z490 Aorus Master, на которую и была перенесена дальнейшая работа.

Для владельца платы из списка совместимости все становится простым и удобным — все управление конфигурациями осуществляется прямо из UEFI Setup — как будто все было бы встроено в системную плату. Основными, естественно, являются создание, удаление (поскольку изначально накопитель «размечен» весь под RAID0, любые изменения придется начинать с него) и перестроение массивов. В принципе, как таковая инструкция не нужна — все интуитивно понятно. Практически единственный, поддающийся настройке параметр — размер блока, хотя его можно и не трогать, за исключением каких-то специфических случаев и самостоятельном тестировании для выбора наиболее подходящего блока под конкретную задачу (hint: практически никому и никогда не удается существенно улучшить производительность по сравнению с выбранным разработчиком контроллера значением по умолчанию).

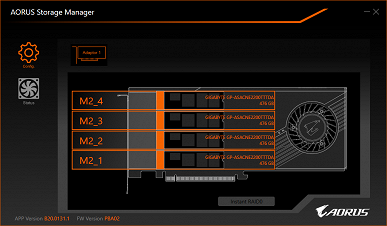

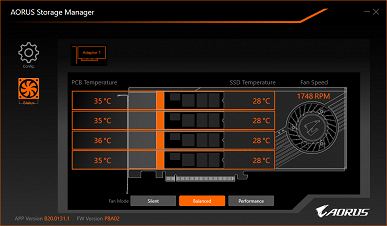

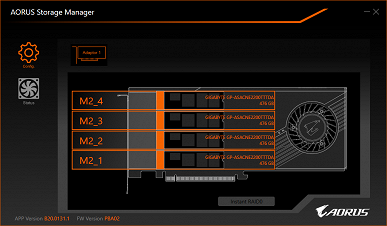

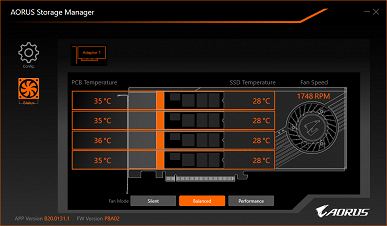

Кроме того, компания предлагает специальную утилиту Aorus Storage Manager — которая как раз позволяет переключать профили работы встроенного вентилятора и получать информацию о текущем температурном режиме. Однако ей официально подходят лишь четыре линейки плат из упомянутых выше пяти — ничего не получится и на «родных» платах на базе Z390. На продукции других производителей — тем более: утилита устанавливается и запускается, но ничего не показывает (а не то, чтоб настроить не давала).

Считать ли это все серьезными ограничениями сферы применения? Этот вопрос каждому придется решить для себя самостоятельно. Повторимся — накопитель продается изначально сконфигурированным, причем для системы он просто выглядит как стандартное NVMe-устройство. Однако «поиграться» с конфигурациями при наличии «неподходящей» платы не удастся. Настроить режим работы вентилятора — тоже. Впрочем, у нас никакого желания его менять и не возникло — но все-таки. А «переконфигурировать» накопитель, может быть, и понадобится — если со временем захочется его проапгрейдить в будущем, что вполне возможно. Но придется найти подходящую плату для первичной инициализации — далее-то все, опять же, «инкапсулируется» внутри устройства, так что его можно переставлять в любую систему и использовать по назначению. В общем, при желании обзавестись чем-то таким этаким — реализовать можно и без привязки к производителю системной платы. Но в первую очередь, конечно, устройство нацелено именно на покупателей «собственной» продукции Gigabyte, причем топовых моделей плат. Список которых будет, как нам кажется, расширяться, но все равно останется ограниченным.

Для чего все это может понадобиться — покажут тесты.

Тестирование

Методика тестирования и образцы для сравнения

Методика подробно описана в отдельной статье. Там можно познакомиться с используемым программным обеспечением, а вот аппаратное сегодня будет более разношерстным, нежели обычно.

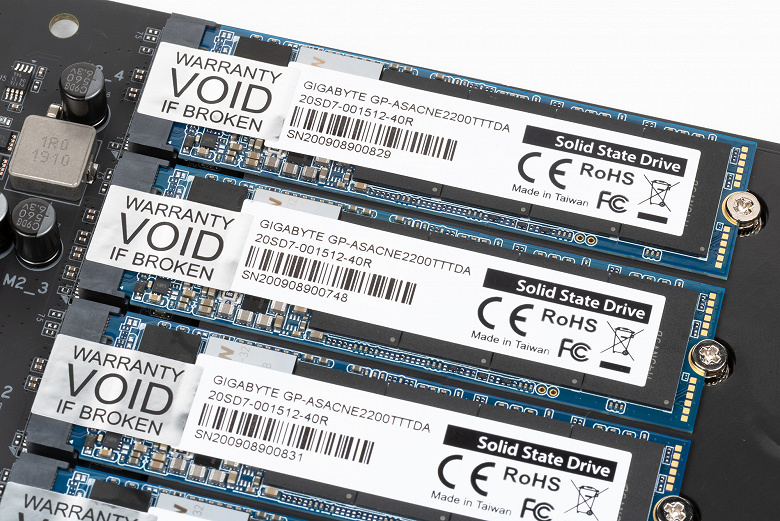

Во-первых, главного героя мы тестировали на плате Z490 Aorus Master и процессоре Core i5-10600K — поскольку в первую очередь Gigabyte Aorus RAID AIC SSD 2 ТБ интересен покупателям таких систем. Некоторые тесты мы провели и на стандартной системе с ASRock Z270 Killer SLI и Core i7-7700 — заметной разницы в быстродействии обнаружить не удалось. Что и ожидалось — дисковые тесты нередко демонстрируют одинаковые (или близкие) результаты даже на более отличающихся платформах, а тут все архитектурно сходно и контроллеры PCIe у Intel тоже давно не менялись. Но в основную линейку мы, все же, эти показатели вносить не будем — а вот пару накопителей для сравнения из нее взять будет можно. В первую очередь, терабайтного Gigabyte Aorus RGB AIC NVMe SSD, а также Gigabyte Aorus NVMe Gen4 SSD на 2 ТБ. Первый интересен тем, что это, фактически, «более толстая» модификация SSD GP-ASACNE2200TTTDA (тот же контроллер и та же память — только в большем количестве), четверка каковых и установлена в RAID AIC SSD. А у второго — та же емкость и новая платформа Phison E16, в частности выделяющаяся поддержкой PCIe 4.0 x4 — что по пропускной способности как раз эквивалентно PCIe 3.0 x8. Но для реализации этого придется воспользоваться платой с чипсетом Х570 и процессором AMD Ryzen 3700X (как обычно).

В итоге чистота эксперимента страдает — у нас целых три разных платы и процессора. Хотя на деле это не так уж и важно. Более интересно как себя будут вести массивы такого рода сравнительно со своими составляющими. А это мы сравнить можем и в абсолютно одинаковых условиях, поскольку конфигурация RAID AIC SSD может гибко меняться. Вот и будем менять, сделав три варианта — одиночный накопитель на 512 ГБ, и два массива RAID0 — из двух и четырех таковых. Промежуточный вариант мы тестировать для экономии времени не стали, RAID1 и RAID10 тоже — понятно, что выбирают их (если и выбирают) вовсе не для повышения скорости. Да и вообще — на данный момент это слишком дорогое удовольствие: отдавать половину емкости флэша ради сокращения времени восстановления после сбоев. Резервное копирование «зеркала» все равно никоим образом не отменяют — вот им в персональном сегменте можно и ограничиться. А скорости и емкости — бывает, что и не хватает. Главное — понимать: какой именно скорости.

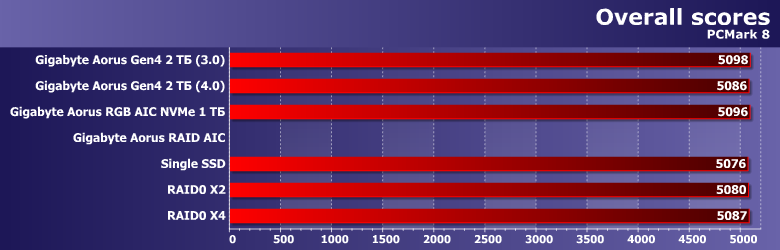

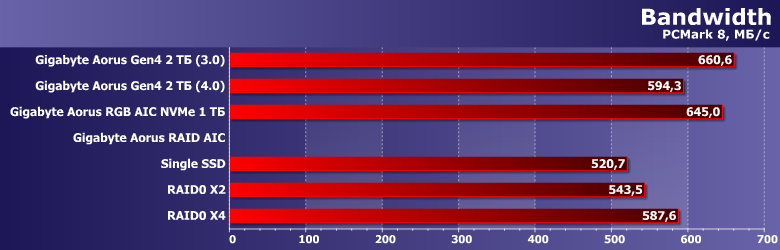

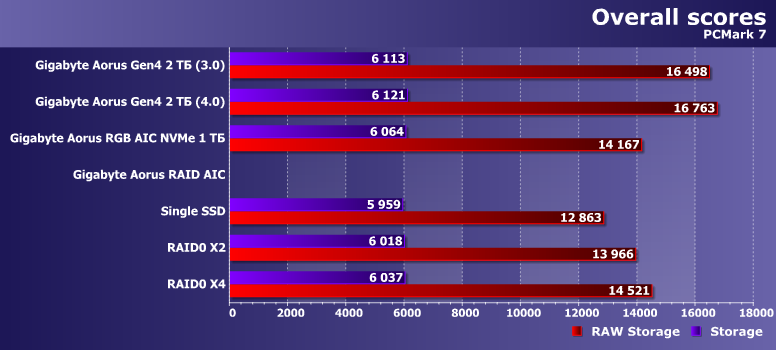

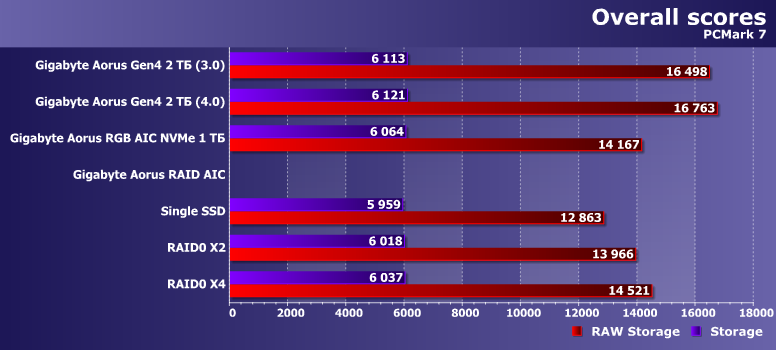

Производительность в приложениях

Поскольку если встает вопрос о системном быстродействии, то здесь массивы стали бесполезными сразу после перехода от «механики» к твердотельным накопителям. Вот из жестких дисков что-то в RAID0 выжать было реально — вследствие низкого параллелизма одиночного устройства, что немного (но не принципиально) улучшалось при использовании одновременно двух или более. Но одиночный SSD в качестве системного обеспечивает более высокий уровень пропускной способности и меньшие задержки, чем может на самом деле понадобиться программному обеспечению. Проще говоря, даже бюджетные модели редко оказываются узким местом — «затыки» происходят в других местах, а не в дисках. Aorus RAID AIC можно использовать как быстрый и емкий системный накопитель — но большого выигрыша от такого подхода получить не удастся. Можно просто купить «приличный» SSD на те же 2 ТБ (а то и меньше — для самих программ терабайты дискового пространства обычно не требуются) — и получить примерно тоже самое.

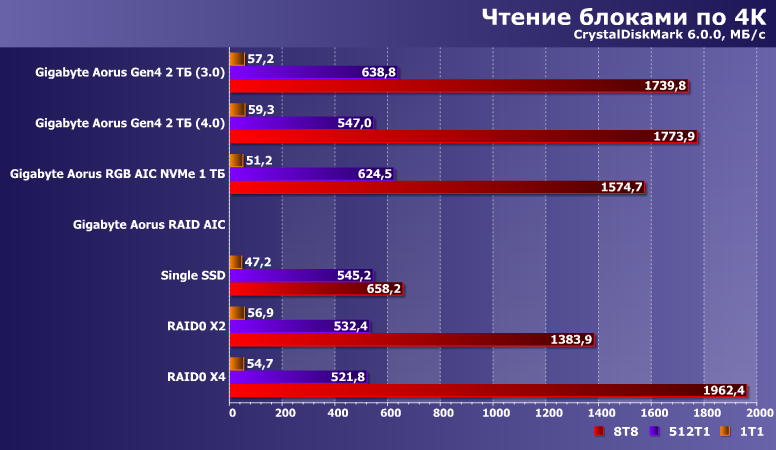

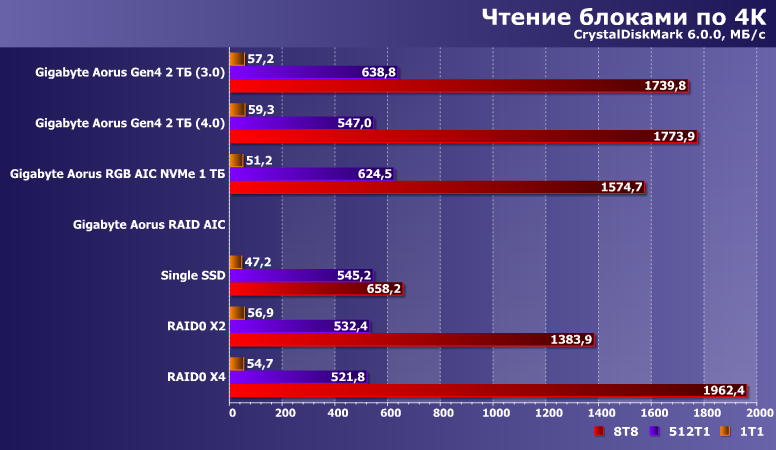

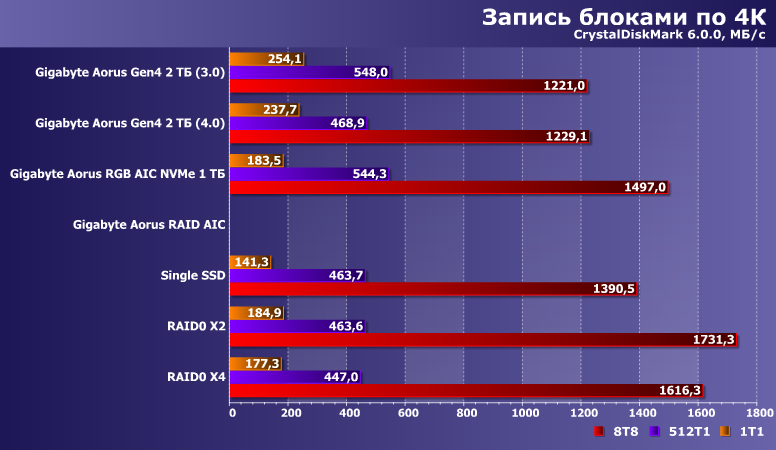

Последовательные операции

Иное дело — последовательные операции. Сделать одиночный SSD, который будет полностью выбирать возможности PCIe 3.0 x4 хотя бы при чтении — можно. А вот переход к более быстрым интерфейсам пока сложен — точнее, возможен, но дает куда меньший эффект, чем можно было бы предположить, сравнивая спецификации. Слабым местом Marvell 88NR2241 является подключение «внутренних» SSD всего двумя линиями PCIe 3.0 — сильным то, что их можно объединить в массив с четырехкратным чередованием. Двукратное же на первый взгляд практически ничего не дает, но для окончательной оценки стоит посмотреть на результаты работы на файловом уровне: CDM, как мы уже не раз говорили, имеет и свою специфику (особенно в однопоточном режиме).

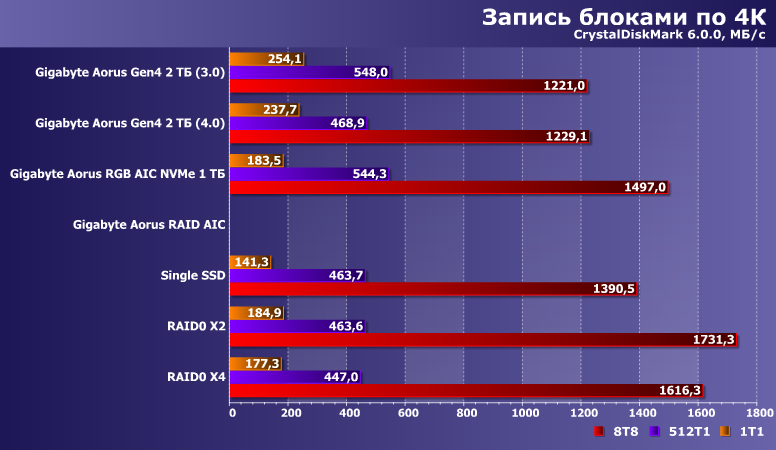

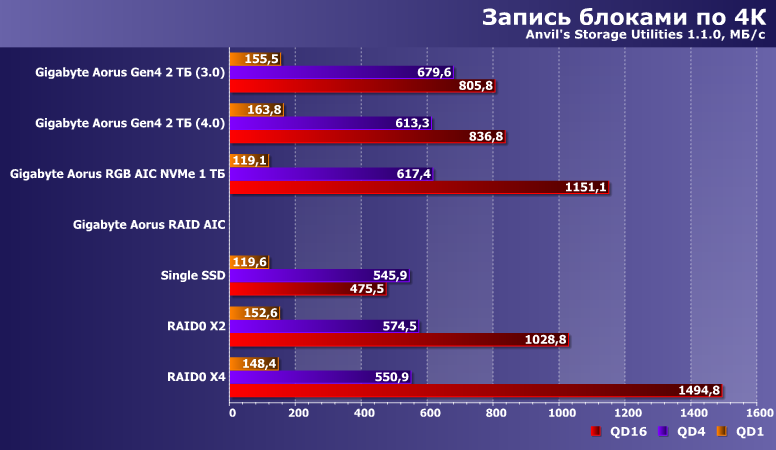

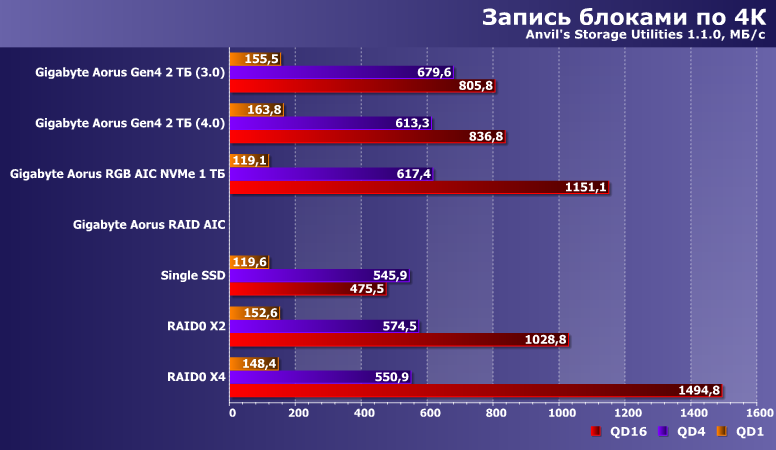

А результаты записи и в исполнении этой программы любопытны. Не для RAID0 из двух дисков, впрочем — ограничение ширины интерфейса дает о себе знать и в этом случае. Так что «полноценной» конфигурацией стоит считать как раз полную — четырехдисковый массив. Который быстрее, чем доступные сегодня накопители с интерфейсом PCIe 4.0 x4 — напомним, что все они пока одинаковые, и Phison для E16 «обещает» максимум 4,4 ГБ/с (причем «забывая» сказать, что это лишь в пределах SLC-кэша). В данном случае пределы выше — при использовании PCIe 3.0 x8 мы и правда можем приблизиться к ограничениям интерфейса очень-очень близко. Понятно, что производительность накопителей под PCIe 4.0 будет расти, однако до сих пор подавляющее большинство устройств с интерфейсом PCIe 3.0 x4 его возможности при записи данных даже в самых удобных случаях «не выбирают». Четырехканальные контроллеры в бюджетных устройствах и вовсе за лимиты двух линий PCIe 3.0 пока не вышли — так что не важно: сколько их там будет и каких. В общем, тенденции понятны. И тем более ценны методы их обхода — которые нужны далеко не всем, но если уж нужны...

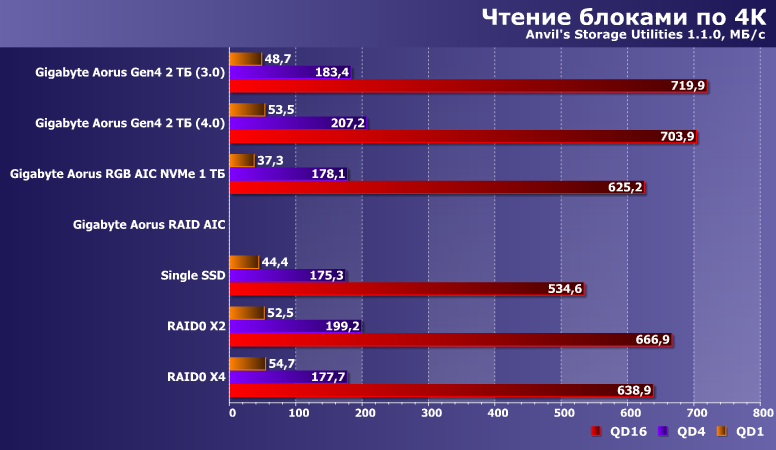

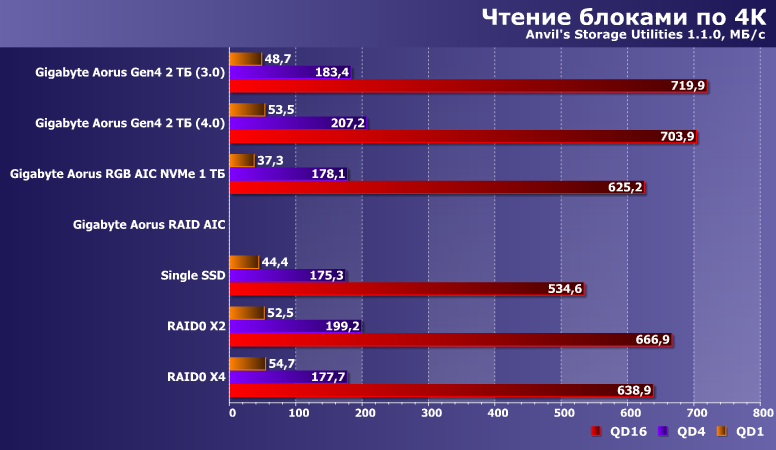

Случайный доступ

Тех же, кому нужна высокая производительность на нагрузках с произвольной адресацией «порадовать» нечем. Понятно — почему: определяется она задержками самого носителя данных, какие-либо оптимизации возможны лишь в синтетических условиях, да и для них более чем достаточно внутреннего параллелизма (жестким дискам массивы «помогали» потому, что у них-то «внутреннего» нет — так что «внешний» работал очень эффективно). Поэтому, точно также, как в свое время находкой оказался NAND-флэш (обеспечивший снижение собственной латентности в 20 раз сравнительно с «механикой»), для дальнейшего увеличения скорости нужно уже уходить... на не-NAND. Например, на Optane — что позволит увеличить производительность еще в несколько раз, даже в таких «сложных случаях», как произвольное чтение без очереди. Однако массовой необходимости в этом нет, а в условиях персонального окружения — и не предвидится. В итоге можно ограничиться и «приличным» устройством на базе флэш-памяти. Главное понимать, что выше головы не прыгнешь, т. е. ни ускорение интерфейса, ни создание массивов накопителей в общем и целом уровень производительности не изменит. Что и можно увидеть на диаграммах ниже.

В общем и целом, самым медленным можно считать «базовый элемент» Aorus RAID AIC: не самый быстрый контроллер Phison E12, небольшая емкость в 512 ГБ, ограничение интерфейса до PCIe 3.0 x2, подключение через дополнительный мост в конце концов — все это иногда определенные ограничения накладывает. Но даже в таком виде уровень производительности оказывается избыточным для современного ПО. А радикально увеличить его невозможно любыми методами. Даже такими радикальными, как полная смена контроллера, памяти, и хост-системы — не говоря уже о простом создании RAID-массива. С другой стороны, на практике оно и не нужно. А если нужно — единственный вариант решения проблемы озвучен выше. Хороший технически — но избыточно дорогой.

Работа с большими файлами

А массивы RAID0 из SSD хороши последовательными скоростями. Даже и «чисто последовательными» — при которых полностью «загрузить работой» массив флэш-памяти обычно не удается, но параллельная работа нескольких контроллеров со своими массивами эту задачу решает несколько лучше. Да и максимальная скорость в многопоточном режиме заметно выше, чем можно получить от нынешнего поколения накопителей с интерфейсом PCIe 4.0. При этом 4.0 — это всегда новая платформа, причем подходящих все еще не так и много, а слот PCIe 3.0 x8 можно найти и во многих системах первой половины прошедшего десятилетия. В принципе, если не ставить задачи загружаться и «не обижать» видеокарту, так подойдут и топовые платы LGA1155 с процессорами семейства Ivy Bridge — а это вообще 2012 год еще.

Запись же для SSD на базе TLC-памяти — задача куда более сложная. При ограниченных объемах данных проблему можно ослабить использованием SLC-кэширования — но ослабить, а не решить полностью. К тому, же при больших объемах данных и небольшом количестве свободного места кэш гарантировано «кончится». Массив же из четырех накопителей, как уже показано было выше, и в худших случаях будет удерживаться на уровне порядка 2 ГБ/с, т. е. скорость получается не просто высокой — а стабильно высокой. Иногда это, даже, более важно.

Это же приводит к интересным результатам и на смешанных операциях — где Aorus RAID AIC оказывается самым быстрым. Естественно, в конфигурации по умолчанию и при последовательной обработке файлов. Произвольную же адресацию RAID0 (как мы уже убедились) практически не ускоряет. Во всех случаях, когда «внутреннего параллелизма» хватает — для одиночного SSD на 512 ГБ это, все-таки, не слишком выполняется, почему и пара таковых работает существенно быстрее.

Рейтинги

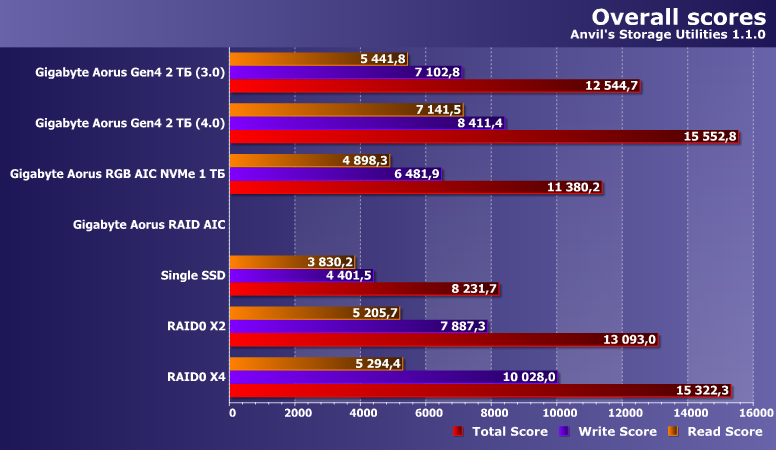

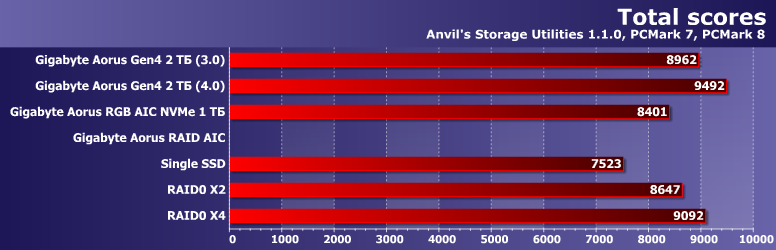

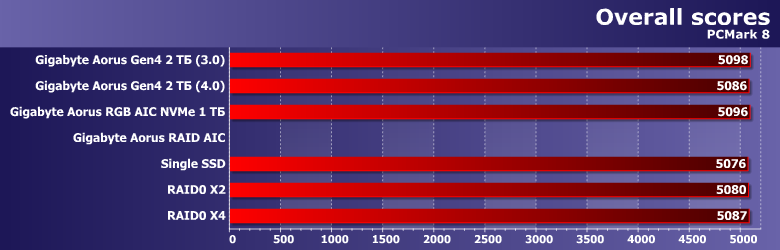

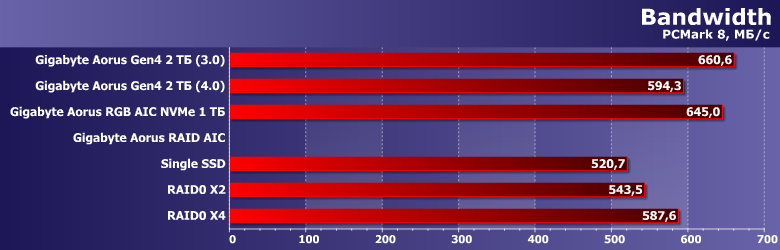

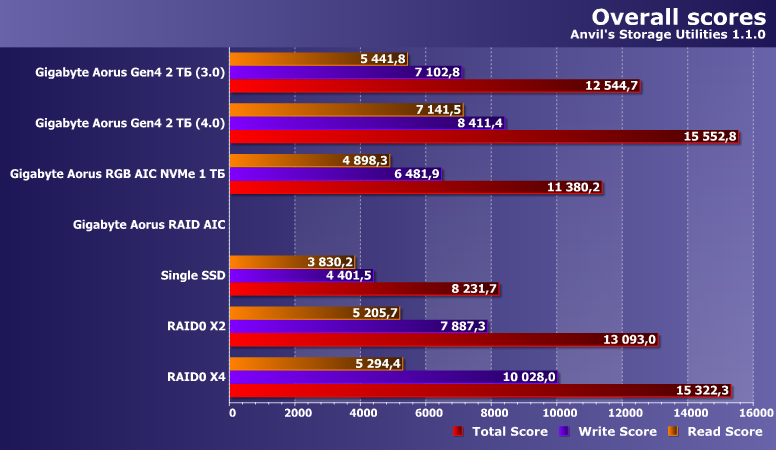

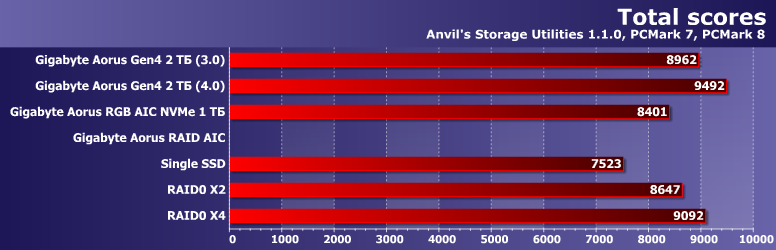

Максимальный упор в этой программе делается на операции с произвольной адресацией — а они (как уже было показано выше) реагируют на «RAIDостроение» очень вяло. Впрочем, оценки «по очкам» все равно немного растут, но это можно считать и эффектом низкой базы. По сути, даже выбранная по умолчанию самая быстрая конфигурация лишь немного обгоняет одиночный SSD аналогичной полной емкости на чуть более быстром контроллере на операциях записи. На чтении — и вовсе отстает даже при использовании последним PCIe 3.0, не говоря уже о более быстрой системе с PCIe 4.0 Поэтому просто надо запомнить, что RAID0 — не панацея. В некоторых случаях он, впрочем, полезен — но все они штучные и выше мы показали все «удачные» сценарии.

«Системная производительность» к таковым, очевидно, не относится — тут, как раз, более значим произвольный доступ, да и даже «приличный» SATA-накопитель «тормозить» прикладное ПО персонального назначения не может. Поэтому для таких устройств, как Gigabyte Aorus RAID AIC SSD, обобщенный рейтинг имеет еще меньше смысла, чем низкоуровневый.

Итого

В общем и целом, устройство получилось нишевым. Вдвойне нишевым его делает ориентация на ограниченный ассортимент системных плат — только производства Gigabyte Aorus, причем только на топовых чипсетах. Впрочем, если относиться к Gigabyte Aorus RAID AIC как к «монолитному» SSD, его можно поставить в любую плату и использовать в конфигурации по умолчанию (которая, очевидно, еще и самая быстрая). Но гибкости в данном случае не будет. И для апгрейда накопителя (а он вполне возможен) придется найти соответствующую плату — иначе не получится настроить его по-новому.

Так что универсальности можно было бы и добавить, благо технически это возможно, однако сделано это не было. Впрочем, критиковать Gigabyte за принятое решение мы не планируем — все равно накопитель получился достаточно своеобразным. Для нас же он был интересен в первую очередь даже не как пример реализации «одноплатного RAID», а с целью поиска практического смысла RAID из SSD в современных условиях. Мы убедились, что смысл есть — но в ограниченном количестве сценариев, причем часть из них с легкостью перекрывается встроенными в современные операционные системы средствами. Однако это не особенность конкретного устройства, а, скажем так, общая проблема.

Что же касается именно Gigabyte Aorus RAID AIC SSD 2 ТБ, то интересен он как минимум в качестве оригинального решения — на что рынок накопителей традиционно беден. Понятно, что на массовость такая конструкция не претендует (помимо прочего, стоимость накопителя емкостью 2 ТБ составляет на момент анонса статьи 30-35 тысяч рублей), но некоторые задачи решает превосходно. К тому же, она способна расти вслед за запросами пользователя — что тоже немаловажно, поскольку ориентирована на наиболее требовательных покупателей.

2 ИЮЛЯ 2020 Г.

АНДРЕЙ КОЖЕМЯКО

Немного сложнее в случаях, когда требуется не только высокая емкость, но и скорость. Причем, желательно, стабильно-высокая скорость. И речь не о пресловутом «рандоме» — на деле возможностей флэш-памяти достаточно для того, чтобы даже бюджетный SSD обеспечивал все сегодняшние требования к «персональному» накопителю с запасом. «Затык» случается совсем в другом месте — с, казалось бы, простыми линейными операциями. Впрочем, простыми они казались во времена винчестеров, когда выполнялись медленно, но на фоне того, как с любыми другими нагрузками «механика» справлялась ужасно медленно, проблем заметно не было. Твердотельные накопители с любыми операциями управляются быстро или очень быстро, но если чтение данных (в любом виде) проблем не вызывает никогда, то с записью все сложнее. Особенно в свете тенденции увеличения плотности чипов, что приводит к снижению их «собственной» скорости записи. Маскировать это приходится изощренными схемами буферизации, которые справляются в относительно простых случаях, но нередко пасуют при увеличении нагрузки. Современный SSD может писать данные со скоростью несколько гигабайт в секунду — но недолго. На такой скорости можно записать в лучшем случае треть свободного места (которого на рабочем устройстве может быть немного), а дальше она снизится до нескольких сотен (а то и десятков) мегабайт в секунду.

Спасает только то, что методы борьбы с такими проблемами давно известны: объединение дисков в массивы с чередованием позволяет существенно увеличить скорость выполнения операций с последовательным доступом. Вот «рандом» в массиве SSD подстегнуть практически невозможно (поскольку внутренний параллелизм справляется не хуже внешнего — а он в этих устройствах, в отличие от жестких дисков, есть всегда), но это и не требуется. Требуется же увеличить скорость последовательного чтения — и записи тоже, причем сделав последнюю более стабильной. Правда, собирать массив из SATA SSD уже неинтересно: суммарная скорость все равно будет ограничена пропускной способностью самого интерфейса, просто умножится на количество используемых устройств. В итоге RAID0 из шести SATA-устройств, например, только-только догонит (как минимум, при чтении) одиночный NVMe-накопитель. Стало быть, массив следует строить из NVMe SSD. Это логично, эффективно, перспективно — однако линий PCIe в типичной настольной системе маловато, так что без ухищрений и без ущерба для других устройств редко получается собрать массив из более чем трех-четырех накопителей. В HEDT-системах самих линий PCIe порядком, но обычно они распределены по «длинным» слотам, зачастую не поддерживающим расщепление, так что идея воткнуть в PCIe x16 пассивный адаптер под четыре SSD может и не прокатить. И даже если получится, то программные средства для создания таких массивов могут оказаться платными — либо сильно ограниченными.

Однако и такие проблемы производители тоже научились решать давно. Столько же лет, сколько используются и дисковые массивы. Просто некогда RAID-контроллер устанавливался в разъем системной шины, а к нему подключались накопители с интерфейсом SCSI или PATA (для экономии) — сейчас же с обеих сторон PCIe. Тоже ничего особенного: чипы-коммутаторы встречались со времен появления PCI Express. Остается научить такой «разветвитель» прикидываться NVMe-накопителем и поддерживать подключение (с возможностью объединения) четверки таких накопителей к «исходящим» линиям, и получим мы... например, контроллер Marvell 88NR2241. Он является дальнейшим развитием линейки SATA/SAS-контроллеров компании, но представляет собой перенос «традиционной» функциональности на более высокий уровень. Естественно, популярен он в корпоративном секторе, для которого и разработан. В то же время, стоит Marvell 88NR2241 не слишком дорого, так что пригоден и для создания интересных продуктов «персонального» назначения. Таких, как наш сегодняшний герой.

Gigabyte Aorus RAID AIC SSD 2 ТБ

В ассортименте компании эта модель дополняет AIC-линейку SSD на базе контроллера Phison E12, куда ранее входили два накопителя — емкостью 512 ГБ и 1 ТБ, а больше среди устройств с интерфейсом PCIe 3.0 и не было. Вот для PCIe 4.0 компания выпускает SSD формата M.2 2280 с емкостью до 2 ТБ, и похожую внешне (но не внутренне!) AIC-плату на 8 ТБ, причем первые полностью совместимы и со старыми системами — так что вроде бы новинка не так уж нужна. Ту же емкость можно получить и в более компактном исполнении — и также можно устанавливать четыре SSD в один слот PCIe x16. Только вот «старшее» AIC-решение дополнительными контроллерами не снабжено, так что для его работы в обязательном порядке требуется расщепление линий в слоте — а таких моделей системных плат не слишком много. В остальных случаях будет «виден» только один SSD из четырех, а Aorus RAID дает доступ ко всем — на любой системе любого производителя, причем можно устанавливать устройства в слоты PCIe x4 или и вовсе х1 (скорость это ограничит, но физически работать будет). Возможность установить четыре накопителя в разъем для одного, в общем-то, востребована, но лучше всего использовать устройство в слоте с восемью линиями: это самый быстрый режим. По пропускной способности PCIe 3.0 x8 и PCIe 4.0 x4 равны, так что компания позиционирует карту Aorus RAID AIC как лучшее решение для модернизации старых систем, владельцы которых хотели бы оценить прелести PCIe 4.0, но не могут. На деле же все гораздо интереснее, чем кажется на первый взгляд

В первую очередь — благодаря наличию упомянутого выше контроллера Marvell 88NR2241, который позволяет гибко настраивать режимы работы «внутреннего» дискового пула, прозрачным для системы образом. Например, все SSD могут работать независимо — т. е. это как раз способ «воткнуть» четыре накопителя в разъем для одного. Ограничением скорости в таком режиме можно и пренебречь — в конце концов, в системах на базе процессоров Intel те же четыре линии PCIe 3.0 служат и для связи чипсета с процессором, т. е. такое узкое место существует и если устанавливать их в отдельные слоты PCIe/M.2, подключенные к чипсету. Однако на практике чтобы в него «упереться» приходится специально постараться — и создать не встречающиеся в реальной жизни условия. Аналогичное верно и для подобных массивов. Но лучше, конечно, «найти» свободный длинный слот — благо 88NR2241 для связи с системой может использовать до восьми линий PCIe 3.0! Правда в настольных платформах LGA115x/LGA1200/AM4 сделать это можно только «обидев» видеокарту, что не всегда желательно. А вот в LGA2011-3/LGA2066 или TR4 свободный длинный слот можно найти и не в ущерб другим компонентам, так что для них такие сборки более интересны.

«Выжать» же максимум из интерфейса можно, используя накопители не поодиночке, а объединив их в массив. По умолчанию карта и сконфигурирована как RAID0 из четырех устройств — суммарной емкостью 2 ТБ. На самом деле контроллер поддерживает и другие варианты — например, массив RAID10: с емкостью в 1 ТБ, высокой скоростью, но защитой от выхода их строя любого из четырех SSD. А можно сделать и RAID1 из пары SSD — и RAID0 из другой пары: получим быстрый дисковый пул на 1 ТБ и отказоустойчивый еще на 500 ГБ. Что, конечно, при нынешних ценах на SSD выглядит немного натянутым — но может кому-то оказаться и интересным. Либо еще один практический вариант — RAID0 из трех SSD (емкость 1,5 ТБ) плюс одиночный накопитель на 500 ГБ.

Хотя на деле можно оставить и все как есть — используя чередование для увеличения скорости. Во-первых, это всегда будет выполнено для операций чтения — как раз так можно «загрузить» работой PCIe 3.0 x8. Во-вторых, ситуация с записью еще более забавная. Ни для кого не секрет, что современные SSD активно используют SLC-буферизацию, а все скоростные показатели декларируются именно для SLC-кэша, имеющего ограниченные размеры: в любом случае не больше трети свободного места. Если необходимо записать большее количество информации, скорость записи радикально упадет. Например, недавно мы тестировали терабайтный Seagate FireCuda 520 с интерфейсом PCIe 4.0 и выяснили, что новый интерфейс имеет значение лишь при ограниченных объемах данных. А после исчерпания кэша скорость записи снижалась до 500-600 МБ/с. Т. е. новейший SSD в некоторых случаях можно считать и за ограничения SATA600 не вышел — что сильно расстраивает пользователей, вынужденных «ворочать» большими объемами данных.

Чем нам могут помочь массивы? Начнем со случая одиночного накопителя — как базы. Хорошо заметно, что быстродействие «базового» элемента примерно соответствует другим SSD на базе контроллера Phison E12 с TLC-памятью Kioxia BiCS3 той же емкости — в SLC-кэш они умеют писать со скоростью более 1,5 ГБ/с, а вот в основной массив памяти — лишь примерно 550 МБ/с. Повторимся — это не особенность конкретной модели, а стандартное поведение SSD этого класса. Из 1-2 ТБ можно выжать и больше — но не принципиально больше. Пиковые скорости, разве что, будут выше — поскольку 88NR2241 каждому отдельному SSD отводит лишь две линии PCIe 3.0, но актуальны они в случае одиночного устройства лишь в небольшой области.

Но если добавить внешнего параллелизма — скорости при последовательной нагрузке закономерно складываются, так что получаем мы стабильно не ниже 1 ГБ/с, а в пиках — и 3 ГБ/с. Второе может обеспечить и одиночный терабайтник, первое — лишь редкие таковые модели.

А четверка SSD (конфигурация по умолчанию) дает уже стабильно около 2 ГБ/с на основной части массива и 5 ГБ/с в «быстрой» области. Отметим, что первое-то можно получить в устройствах высокой емкости («небытовых» официально, хотя временами и относительно недорогих), а вот второе в обязательном порядке требует поработать с внешним интерфейсом.

Но есть один момент, который необходимо учитывать — массивы положительно сказываются на скорости выполнения последовательных операций, однако на «рандом» в случае SSD действуют не всегда — и не всегда в положительную сторону. В принципе, на практике в персональном компьютере это не мешает, поскольку даже бюджетные твердотельники не просто отлично справляются с типичными нагрузками такого плана, но и делают это с запасом — но помнить об этом стоит. Единственный вариант действительно ускорить практически значимые показатели на операциях со случайным доступом — отказаться от NAND-флэш и перейти на, например, Optane. Но это совсем иная история... а вот «ворочать» большими объемами информации в случае RAID-массивов становится удобнее, чем без них.

При этом такие решения, как Aorus RAID AIC SSD позволяют снять некоторые проблемы, мешающие активному использованию программных и «чипсетных» массивов. Первое-то давно встроено в операционные системы — только вот проблемы нередко возникают даже с загрузкой самой системы. Да и со свободными слотами они тоже нередки — не на всякую плату, например, можно установить сразу четыре SSD и объединить их в массив. Свои ограничения есть зачастую и у HEDT-систем, где с возможностью подключения попроще — но и только. Marvell 88NR2241 инкапсулирует всю логику внутри — для системы это просто обычный NVMe-накопитель или несколько таких (до четырех). Соответственно, работает это на любых платах, под управлением практически любых ОС и т. п. По большому счету смысл есть даже если найдется только свободный слот с четырьмя линиями PCIe — а восемь позволят и увеличить пиковую скорость.

Кроме того, можно не заботиться о температурном режиме накопителей — что до сих пор иногда вызывает проблемы. В данном случае адаптер снабжен и большим радиатором для всех накопителей, и вентилятором для продува системы. Скорость вращения последнего выбрана таковой, чтобы не выделяться на общем фоне системы. На деле, даже, во время тестирования нам сначала казалось, что специально установлен минимальный уровень шума. Проверка показала, что это средний профиль - можно сделать еще тише. Или, наоборот, холоднее.

Правда с конфигурированием и настройками уже возможны некоторые ограничения.

Совместимость и управление

Конкретный адаптер сделан (если к этому абзацу кто-то уже забыл) Gigabyte. При этом ограничений на начинку компания не накладывает: внутри установлены SSD ее производства, причем их извлечение лишает гарантии, но после ее окончания (или если это не пугает) — можно и поменять на другие. Причем то, что контроллер, в общем-то, multi-LUN, позволяет апгрейдить устройство и «по частям» — по мере возникновения необходимости.

Что касается «наружного» интерфейса, то с ним на первый взгляд тоже все отлично — как уже сказано, устройство прекрасно работает в любых системных платах всех производителей, причем скоростной режим ограничен лишь сверху, но не снизу. В частности, мы устанавливали Aorus RAID в нашу стандартную тестовую систему на базе платы ASRock Z270 Killer SLI — отлично функционировала как в процессорных слотах, так и в чипсетных PCIe x1 (благо они там «пропиленные»); пусть и на ограниченной скорости. Однако при этом исчезают все возможности конфигурирования, т. е. даже массив не перестроишь.

Полное управление обеспечивается исключительно при использовании плат Aorus/Gigabyte на базе чипсетов AMD X570 и TRX40, а также Intel X299, Z390 и Z490. К счастью, у нас под рукой как раз оказалась новенькая Z490 Aorus Master, на которую и была перенесена дальнейшая работа.

Для владельца платы из списка совместимости все становится простым и удобным — все управление конфигурациями осуществляется прямо из UEFI Setup — как будто все было бы встроено в системную плату. Основными, естественно, являются создание, удаление (поскольку изначально накопитель «размечен» весь под RAID0, любые изменения придется начинать с него) и перестроение массивов. В принципе, как таковая инструкция не нужна — все интуитивно понятно. Практически единственный, поддающийся настройке параметр — размер блока, хотя его можно и не трогать, за исключением каких-то специфических случаев и самостоятельном тестировании для выбора наиболее подходящего блока под конкретную задачу (hint: практически никому и никогда не удается существенно улучшить производительность по сравнению с выбранным разработчиком контроллера значением по умолчанию).

Кроме того, компания предлагает специальную утилиту Aorus Storage Manager — которая как раз позволяет переключать профили работы встроенного вентилятора и получать информацию о текущем температурном режиме. Однако ей официально подходят лишь четыре линейки плат из упомянутых выше пяти — ничего не получится и на «родных» платах на базе Z390. На продукции других производителей — тем более: утилита устанавливается и запускается, но ничего не показывает (а не то, чтоб настроить не давала).

Считать ли это все серьезными ограничениями сферы применения? Этот вопрос каждому придется решить для себя самостоятельно. Повторимся — накопитель продается изначально сконфигурированным, причем для системы он просто выглядит как стандартное NVMe-устройство. Однако «поиграться» с конфигурациями при наличии «неподходящей» платы не удастся. Настроить режим работы вентилятора — тоже. Впрочем, у нас никакого желания его менять и не возникло — но все-таки. А «переконфигурировать» накопитель, может быть, и понадобится — если со временем захочется его проапгрейдить в будущем, что вполне возможно. Но придется найти подходящую плату для первичной инициализации — далее-то все, опять же, «инкапсулируется» внутри устройства, так что его можно переставлять в любую систему и использовать по назначению. В общем, при желании обзавестись чем-то таким этаким — реализовать можно и без привязки к производителю системной платы. Но в первую очередь, конечно, устройство нацелено именно на покупателей «собственной» продукции Gigabyte, причем топовых моделей плат. Список которых будет, как нам кажется, расширяться, но все равно останется ограниченным.

Для чего все это может понадобиться — покажут тесты.

Тестирование

Методика тестирования и образцы для сравнения

Методика подробно описана в отдельной статье. Там можно познакомиться с используемым программным обеспечением, а вот аппаратное сегодня будет более разношерстным, нежели обычно.

Во-первых, главного героя мы тестировали на плате Z490 Aorus Master и процессоре Core i5-10600K — поскольку в первую очередь Gigabyte Aorus RAID AIC SSD 2 ТБ интересен покупателям таких систем. Некоторые тесты мы провели и на стандартной системе с ASRock Z270 Killer SLI и Core i7-7700 — заметной разницы в быстродействии обнаружить не удалось. Что и ожидалось — дисковые тесты нередко демонстрируют одинаковые (или близкие) результаты даже на более отличающихся платформах, а тут все архитектурно сходно и контроллеры PCIe у Intel тоже давно не менялись. Но в основную линейку мы, все же, эти показатели вносить не будем — а вот пару накопителей для сравнения из нее взять будет можно. В первую очередь, терабайтного Gigabyte Aorus RGB AIC NVMe SSD, а также Gigabyte Aorus NVMe Gen4 SSD на 2 ТБ. Первый интересен тем, что это, фактически, «более толстая» модификация SSD GP-ASACNE2200TTTDA (тот же контроллер и та же память — только в большем количестве), четверка каковых и установлена в RAID AIC SSD. А у второго — та же емкость и новая платформа Phison E16, в частности выделяющаяся поддержкой PCIe 4.0 x4 — что по пропускной способности как раз эквивалентно PCIe 3.0 x8. Но для реализации этого придется воспользоваться платой с чипсетом Х570 и процессором AMD Ryzen 3700X (как обычно).

В итоге чистота эксперимента страдает — у нас целых три разных платы и процессора. Хотя на деле это не так уж и важно. Более интересно как себя будут вести массивы такого рода сравнительно со своими составляющими. А это мы сравнить можем и в абсолютно одинаковых условиях, поскольку конфигурация RAID AIC SSD может гибко меняться. Вот и будем менять, сделав три варианта — одиночный накопитель на 512 ГБ, и два массива RAID0 — из двух и четырех таковых. Промежуточный вариант мы тестировать для экономии времени не стали, RAID1 и RAID10 тоже — понятно, что выбирают их (если и выбирают) вовсе не для повышения скорости. Да и вообще — на данный момент это слишком дорогое удовольствие: отдавать половину емкости флэша ради сокращения времени восстановления после сбоев. Резервное копирование «зеркала» все равно никоим образом не отменяют — вот им в персональном сегменте можно и ограничиться. А скорости и емкости — бывает, что и не хватает. Главное — понимать: какой именно скорости.

Производительность в приложениях

Поскольку если встает вопрос о системном быстродействии, то здесь массивы стали бесполезными сразу после перехода от «механики» к твердотельным накопителям. Вот из жестких дисков что-то в RAID0 выжать было реально — вследствие низкого параллелизма одиночного устройства, что немного (но не принципиально) улучшалось при использовании одновременно двух или более. Но одиночный SSD в качестве системного обеспечивает более высокий уровень пропускной способности и меньшие задержки, чем может на самом деле понадобиться программному обеспечению. Проще говоря, даже бюджетные модели редко оказываются узким местом — «затыки» происходят в других местах, а не в дисках. Aorus RAID AIC можно использовать как быстрый и емкий системный накопитель — но большого выигрыша от такого подхода получить не удастся. Можно просто купить «приличный» SSD на те же 2 ТБ (а то и меньше — для самих программ терабайты дискового пространства обычно не требуются) — и получить примерно тоже самое.

Последовательные операции

Иное дело — последовательные операции. Сделать одиночный SSD, который будет полностью выбирать возможности PCIe 3.0 x4 хотя бы при чтении — можно. А вот переход к более быстрым интерфейсам пока сложен — точнее, возможен, но дает куда меньший эффект, чем можно было бы предположить, сравнивая спецификации. Слабым местом Marvell 88NR2241 является подключение «внутренних» SSD всего двумя линиями PCIe 3.0 — сильным то, что их можно объединить в массив с четырехкратным чередованием. Двукратное же на первый взгляд практически ничего не дает, но для окончательной оценки стоит посмотреть на результаты работы на файловом уровне: CDM, как мы уже не раз говорили, имеет и свою специфику (особенно в однопоточном режиме).

А результаты записи и в исполнении этой программы любопытны. Не для RAID0 из двух дисков, впрочем — ограничение ширины интерфейса дает о себе знать и в этом случае. Так что «полноценной» конфигурацией стоит считать как раз полную — четырехдисковый массив. Который быстрее, чем доступные сегодня накопители с интерфейсом PCIe 4.0 x4 — напомним, что все они пока одинаковые, и Phison для E16 «обещает» максимум 4,4 ГБ/с (причем «забывая» сказать, что это лишь в пределах SLC-кэша). В данном случае пределы выше — при использовании PCIe 3.0 x8 мы и правда можем приблизиться к ограничениям интерфейса очень-очень близко. Понятно, что производительность накопителей под PCIe 4.0 будет расти, однако до сих пор подавляющее большинство устройств с интерфейсом PCIe 3.0 x4 его возможности при записи данных даже в самых удобных случаях «не выбирают». Четырехканальные контроллеры в бюджетных устройствах и вовсе за лимиты двух линий PCIe 3.0 пока не вышли — так что не важно: сколько их там будет и каких. В общем, тенденции понятны. И тем более ценны методы их обхода — которые нужны далеко не всем, но если уж нужны...

Случайный доступ

Тех же, кому нужна высокая производительность на нагрузках с произвольной адресацией «порадовать» нечем. Понятно — почему: определяется она задержками самого носителя данных, какие-либо оптимизации возможны лишь в синтетических условиях, да и для них более чем достаточно внутреннего параллелизма (жестким дискам массивы «помогали» потому, что у них-то «внутреннего» нет — так что «внешний» работал очень эффективно). Поэтому, точно также, как в свое время находкой оказался NAND-флэш (обеспечивший снижение собственной латентности в 20 раз сравнительно с «механикой»), для дальнейшего увеличения скорости нужно уже уходить... на не-NAND. Например, на Optane — что позволит увеличить производительность еще в несколько раз, даже в таких «сложных случаях», как произвольное чтение без очереди. Однако массовой необходимости в этом нет, а в условиях персонального окружения — и не предвидится. В итоге можно ограничиться и «приличным» устройством на базе флэш-памяти. Главное понимать, что выше головы не прыгнешь, т. е. ни ускорение интерфейса, ни создание массивов накопителей в общем и целом уровень производительности не изменит. Что и можно увидеть на диаграммах ниже.

В общем и целом, самым медленным можно считать «базовый элемент» Aorus RAID AIC: не самый быстрый контроллер Phison E12, небольшая емкость в 512 ГБ, ограничение интерфейса до PCIe 3.0 x2, подключение через дополнительный мост в конце концов — все это иногда определенные ограничения накладывает. Но даже в таком виде уровень производительности оказывается избыточным для современного ПО. А радикально увеличить его невозможно любыми методами. Даже такими радикальными, как полная смена контроллера, памяти, и хост-системы — не говоря уже о простом создании RAID-массива. С другой стороны, на практике оно и не нужно. А если нужно — единственный вариант решения проблемы озвучен выше. Хороший технически — но избыточно дорогой.

Работа с большими файлами

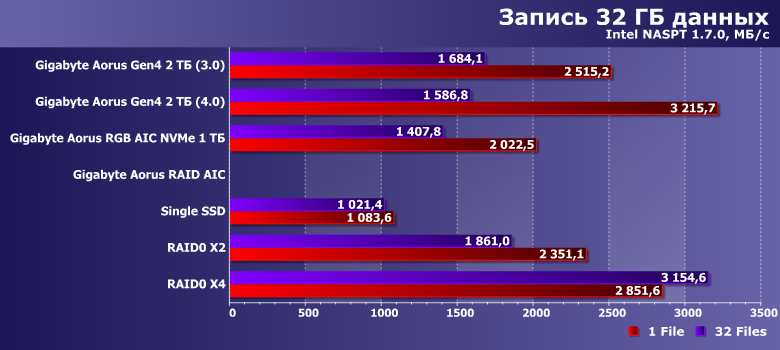

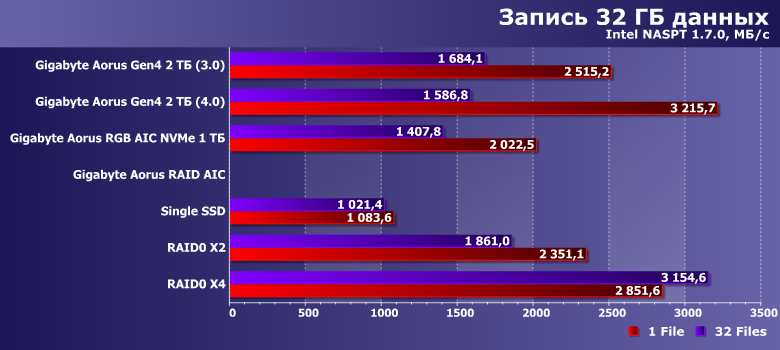

А массивы RAID0 из SSD хороши последовательными скоростями. Даже и «чисто последовательными» — при которых полностью «загрузить работой» массив флэш-памяти обычно не удается, но параллельная работа нескольких контроллеров со своими массивами эту задачу решает несколько лучше. Да и максимальная скорость в многопоточном режиме заметно выше, чем можно получить от нынешнего поколения накопителей с интерфейсом PCIe 4.0. При этом 4.0 — это всегда новая платформа, причем подходящих все еще не так и много, а слот PCIe 3.0 x8 можно найти и во многих системах первой половины прошедшего десятилетия. В принципе, если не ставить задачи загружаться и «не обижать» видеокарту, так подойдут и топовые платы LGA1155 с процессорами семейства Ivy Bridge — а это вообще 2012 год еще.

Запись же для SSD на базе TLC-памяти — задача куда более сложная. При ограниченных объемах данных проблему можно ослабить использованием SLC-кэширования — но ослабить, а не решить полностью. К тому, же при больших объемах данных и небольшом количестве свободного места кэш гарантировано «кончится». Массив же из четырех накопителей, как уже показано было выше, и в худших случаях будет удерживаться на уровне порядка 2 ГБ/с, т. е. скорость получается не просто высокой — а стабильно высокой. Иногда это, даже, более важно.

Это же приводит к интересным результатам и на смешанных операциях — где Aorus RAID AIC оказывается самым быстрым. Естественно, в конфигурации по умолчанию и при последовательной обработке файлов. Произвольную же адресацию RAID0 (как мы уже убедились) практически не ускоряет. Во всех случаях, когда «внутреннего параллелизма» хватает — для одиночного SSD на 512 ГБ это, все-таки, не слишком выполняется, почему и пара таковых работает существенно быстрее.

Рейтинги

Максимальный упор в этой программе делается на операции с произвольной адресацией — а они (как уже было показано выше) реагируют на «RAIDостроение» очень вяло. Впрочем, оценки «по очкам» все равно немного растут, но это можно считать и эффектом низкой базы. По сути, даже выбранная по умолчанию самая быстрая конфигурация лишь немного обгоняет одиночный SSD аналогичной полной емкости на чуть более быстром контроллере на операциях записи. На чтении — и вовсе отстает даже при использовании последним PCIe 3.0, не говоря уже о более быстрой системе с PCIe 4.0 Поэтому просто надо запомнить, что RAID0 — не панацея. В некоторых случаях он, впрочем, полезен — но все они штучные и выше мы показали все «удачные» сценарии.

«Системная производительность» к таковым, очевидно, не относится — тут, как раз, более значим произвольный доступ, да и даже «приличный» SATA-накопитель «тормозить» прикладное ПО персонального назначения не может. Поэтому для таких устройств, как Gigabyte Aorus RAID AIC SSD, обобщенный рейтинг имеет еще меньше смысла, чем низкоуровневый.

Итого

В общем и целом, устройство получилось нишевым. Вдвойне нишевым его делает ориентация на ограниченный ассортимент системных плат — только производства Gigabyte Aorus, причем только на топовых чипсетах. Впрочем, если относиться к Gigabyte Aorus RAID AIC как к «монолитному» SSD, его можно поставить в любую плату и использовать в конфигурации по умолчанию (которая, очевидно, еще и самая быстрая). Но гибкости в данном случае не будет. И для апгрейда накопителя (а он вполне возможен) придется найти соответствующую плату — иначе не получится настроить его по-новому.

Так что универсальности можно было бы и добавить, благо технически это возможно, однако сделано это не было. Впрочем, критиковать Gigabyte за принятое решение мы не планируем — все равно накопитель получился достаточно своеобразным. Для нас же он был интересен в первую очередь даже не как пример реализации «одноплатного RAID», а с целью поиска практического смысла RAID из SSD в современных условиях. Мы убедились, что смысл есть — но в ограниченном количестве сценариев, причем часть из них с легкостью перекрывается встроенными в современные операционные системы средствами. Однако это не особенность конкретного устройства, а, скажем так, общая проблема.

Что же касается именно Gigabyte Aorus RAID AIC SSD 2 ТБ, то интересен он как минимум в качестве оригинального решения — на что рынок накопителей традиционно беден. Понятно, что на массовость такая конструкция не претендует (помимо прочего, стоимость накопителя емкостью 2 ТБ составляет на момент анонса статьи 30-35 тысяч рублей), но некоторые задачи решает превосходно. К тому же, она способна расти вслед за запросами пользователя — что тоже немаловажно, поскольку ориентирована на наиболее требовательных покупателей.

2 ИЮЛЯ 2020 Г.

АНДРЕЙ КОЖЕМЯКО